ChatGPT:三个阶段打造智能对话交互式Al模型

ChatGPT从诞生到现在,经历了三个大版本阶段演进。2018年,生成式预训练模型GPT-1诞生,引入有监督的微调训练。2019年,GPT-2以增加模型通用性为目标,移除 GPT-1的微调,以更大的参数量和多任务训练,进行zero-shot学习;2020年,GPT-3用few-shot代替zero-shot,并将训练参数增加到1750亿,再次提高模型表现性能。2022年,InstructGPT引入基于人类反馈的强化学习(RLHF),在GPT-3基础上进行奖励训练,以13 亿训练参数实现了更好的模型性能。2022年11月,基于 InstructGPT,OpenAl正式推出对话交互式模型ChatGPT,5天时间突破了100万用户。

GPT-1阶段:开启生成式预训练模型时代

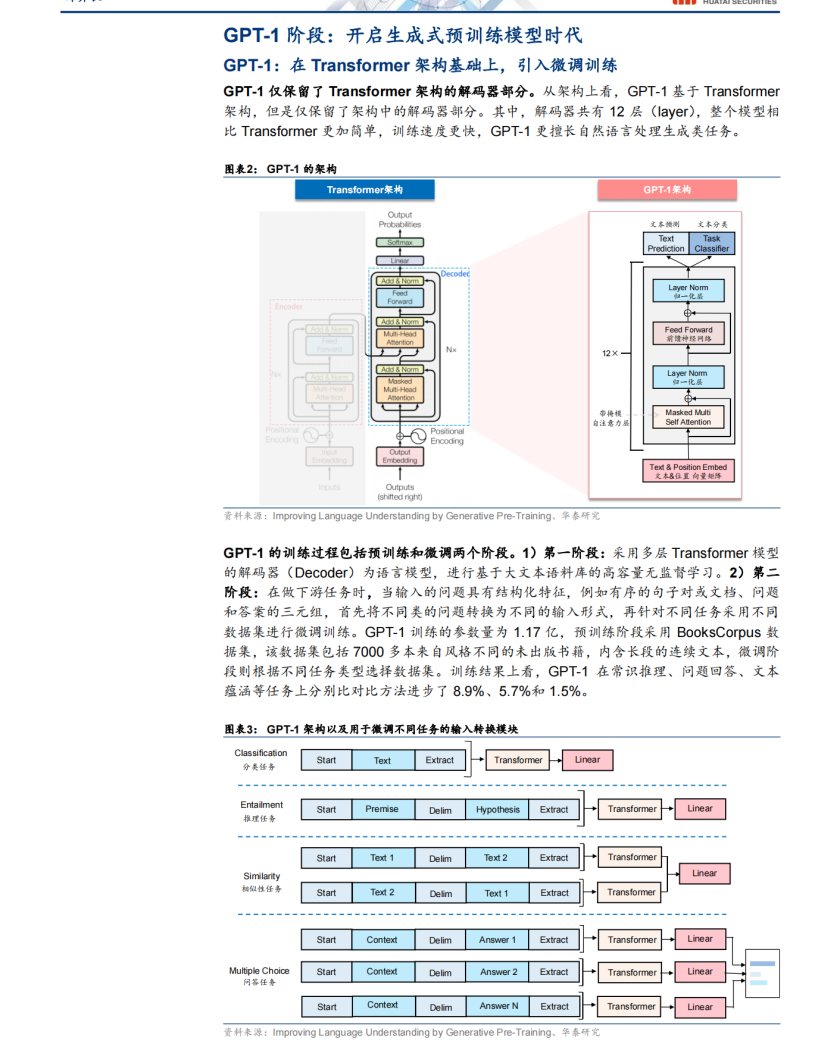

GPT-1基于Transformer架构,仅保留了架构中的解码器(Decoder)部分。GPT-1的训练过程包括预训练和微调两个阶段。1)阶段一:预训练采用内含长段连续文本的BooksCorpus数据集,进行高容量无监督学习。2)阶段二:在做下游任务时,首先根据任务类型将其转换为不同的输入形式,再针对不用类型任务用特定训练集进行微调训练。GPT-1的参数量为1.17亿。GPT-1 在常识推理、问题回答、文本蕴涵等任务上分别比对比方法进步了8.9%、5.7%和1.5%。

GPT-2阶段:无监督训练替代有监督训练

GPT-2通过海量数据和庞大的模型参数训练出更为通用的模型,无需经过特定的数据集训练也能解决各类问题,即 zero-shot learning(零次学习),从而提高模型的泛化能力。GPT-2在架构上与GPT-1基本保持相同,预训练阶段与GPT-1方法一致,采用了更大的数据集WebText。处理下游任务时,以无监督的训练方式进行zero-shot学习,通过增加prompt文本提示的方式提示模型具体任务类型。GPT-2的参数量增加到15亿。GPT-2在命名实体识别、阅读理解等任务上表现优异,在部分任务上不及预期。

GPT-3阶段:性能不断突破,开启商业探索

GPT-3在GPT-2架构基础上,舍弃极端的zero-shot,采用few-shot理念,对于特定任务给予少量(10-100个)样例。GPT-3最大训练参数量为1750 亿,训练结果准确度随着 few-shot样例的增加有明显提高。基于GPT-3,OpenAl发布了Codex和InstructGPT。Codex是通用代码生成模型,能够将自然语言转换为代码,支持十几种编程语言。InstructGPT在GPT-3基础上通过RLHF训练奖励模型来进一步优化训练结果,仅用13亿参数量即可实现更符合人类需求的输出。此外,2020年6月,OpenAl开始对外提供接入GPT-3服务的API,并按照模型类型进行收费,开启商业探索第一步。

ChatGPT阶段:各大互联网厂商争相推出类似产品

2022 年 11 月,基于 InstructGPT,OpenAl 发布了以对话方式交互的ChatGPT。ChatGPT训练方法与InstructionGPT基本相同,区别仅在于在微调时基于InstructGPT而非GPT-3。随着ChatGPT用户的增多,OpenAl 推出了按月订阅的ChatGPTPlus服务,开启第二次商业尝试。国内外互联网厂商纷纷跟进,微软发布基于ChatGPT的新版Bing,谷歌发布Bard对标ChatGPT;百度宣布推出类ChatGPT应用"文心一言",京东推出智能人机对话平台ChatJD,阿里宣布公司正在研发"阿里版"ChatGPT,网易有道和360也表示推出类ChatGPT应用。

赞(0)

赞(0)

粤公网安备 44030502004540号

粤公网安备 44030502004540号